Eine gängige wissenschaftliche Vorgehensweise bei der Untersuchung physikalischer Objekte ist die Anwendung verschiedener, komplementärer experimenteller Methoden, welche sich in ihrer räumlichen und zeitlichen Auflösung, Dimensionalität und modalitätsspezifischen Beschaffenheit unterscheiden und zu einer großen Menge an auszuwertenden Bilddaten führt.

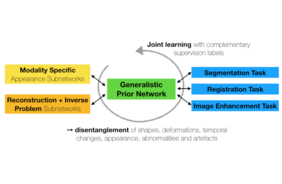

Durch diese Vorgehensweise motiviert soll in dem interdisziplinären Projekt "Multi-task Lernen mit tiefen Faltungsnetzwerken für großskalige Analyse von multimodalen biomedizinischen Bildern (MDMLA)" ein generalistisches Deep Learning Framework entwickelt und implementiert werden, welches eine effiziente, modalitäts- und domänenübergreifende Verarbeitung und Analyse von multimodalen und longitudinalen biomedizinischen Daten ermöglicht.

In enger Zusammenarbeit von Experten aus der Anwender- sowie Machine-Learning-Domäne (DESY, HZG, Syntellix, IMT, IMI) werden neue Multitask Deep Learning Methoden entwickelt, welche die unterschiedlichen komplementären Aufgaben ganzheitlich miteinander kombinieren, sodass Wissen über die einzelnen Analyseaufgaben hinweg transferiert wird. Anschließend werden generische Strukturen innerhalb der entwickelten Netzwerkarchitekturen identifiziert, um ein vereinheitliches, datengesteuertes Framework zu entwerfen, welches auf eine Vielzahl unterschiedlicher Domänen, Modalitäten und Aufgaben anwendbar ist.

Die entwickelten Methoden und Werkzeuge werden auf eine Vielzahl von longitudinalen und multimodalen Datensätzen aus vorklinischen Studien und klinischen Anwendungen, u.A. für die Untersuchung von Knochenimplantaten, angewandt. Die Umsetzung der Methoden auf einer geeigneten Hochleistung-Rechner-Plattform wird zu einem langfristig nutzbaren Dienst führen, der einer Vielzahl von wissenschaftlichen Nutzern zur Verfügung stehen wird.

Das vom BMBF geförderte Projekt hat eine Laufzeit von drei Jahren (2020-2023) und wird mit einer Fördersumme von 1.170.157€ (507.163€ UzL) unterstützt.

Liste der Projektpartner:

- Institut für Medizinische Informatik, UzL (Prof. Dr. Mattias Heinrich)

- Institut für Medizintechnik, UzL (Prof. Dr. Thorsten M. Buzug)

- Deutsches Elektronen-Synchrotron DESY (Dr. Frank Schlünzen, Dr. Philipp Heuser, Dr. Xiaogang Yang)

- Helmholtz-Zentrum Geesthacht (Prof. Dr. Regine Willumeit-Römer, Dr. Julian Moosmann)

- Syntellix AG (Dr. Jan-Marten Seitz)

Projekt-bezogene Veröffentlichung:

Heinrich M.P., Hansen L., Unsupervised learning of multimodal image registration using domain adaptation with projected Earth Move's discrepancies

Medical Imaging with Deep Learning (MIDL 2020, Montreal, short-paper) arXiv Link: https://arxiv.org/abs/2005.14107